PDF_Künstliche Neuronale Netzwerke

Um Daten auszuwerten, gibt es viele Möglichkeiten. Für sehr große Datenmengen, wie sie in populären Chatbots (z. B. ChatGPT) vorkommen, werden sogenannte neuronale Netzwerke (NN) eingesetzt. Zur Wiederholung: Maschinelles Lernen ist ein Teilgebiet der künstlichen Intelligenz (KI). Das maschinelle Lernen umfasst unterschiedliche Algorithmen, um eine KI zu „trainieren“. Die modernsten KI-Modelle basieren auf NN, die als Teil des maschinellen Lernens genutzt werden. Ziel eines jeden Lernalgorithmus ist es, auf Basis gegebener Eingabe- und Ausgabedaten ein Vorhersagemodell zu entwickeln, das auch auf neue, unbekannte Eingabedaten angewendet werden kann.

Warum neuronale Netzwerke Regeln selbst entwickeln

Die „Regeln“ für dieses Vorhersagemodell werden jedoch nicht vom Menschen (also dem Programmierer) selbst geschrieben. Ein Beispiel für solche Regeln wären typische Wenn-Dann-Beziehungen, wie etwa: „Wenn Sensor nass, dann Fenster schließen.“ In unserer komplexen Welt ist es für einen Menschen (auch aus Zeitgründen und vielen Unsicherheiten) nicht möglich, Regeln für jede denkbare Situation zu verfassen. Daher überlassen wir in vielen Fällen neuronalen Netzwerken (NN) die Aufgabe, diese komplexen Regeln zu entwickeln (beispielsweise Regeln, die es einem Computer ermöglichen, selbstständig ein Bild von einer Brücke zu erkennen). NN sind in der Lage, Muster und Beziehungen zwischen Eingabe- und Ausgabedaten zu erkennen, um daraus zahlreiche Regeln für einen spezifischen Anwendungsfall (wie etwa die Bilderkennung) abzuleiten.

Das Konzept neuronaler Netzwerke

Gehen wir auf das Konzept hinter neuronalen Netzwerken (NN) ein. Unser Gehirn besteht aus zahlreichen Nervenzellen (Neuronen), die untereinander Informationen austauschen. Ein Neuron erhält einen Input (einen elektrischen Impuls) und leitet dieses Signal (die Information) an verbundene Neuronen weiter, wenn ein bestimmter „Schwellenwert“ erreicht wird (das Neuron „feuert“). Diese verbundenen Neuronen können wiederum so erregt werden, dass sie das eingehende Signal an weitere Neuronen weiterleiten oder nicht (der Output eines Neurons wird zum Input des nächsten Neurons). Schließlich führt das „Feuern“ bestimmter Neuronen untereinander zu einer Ausgabe

(z. B. „Ich habe das verstanden!“). Diese Prozesse im Gehirn laufen wahnsinnig schnell und kontinuierlich ab. Künstliche neuronale Netzwerke (NN) orientieren sich an diesem Konzept, haben jedoch nur bedingt Ähnlichkeit mit dem biologischen Gehirn. Das einfachste neuronale Netzwerk ist in Abbildung 1 dargestellt.

Deep Learning: Die Komplexität neuronaler Netzwerke verstehen

Ein neuronales Netzwerk (NN) ist in der Praxis deutlich komplexer aufgebaut, als es hier dargestellt wird. Das vorliegende NN verfügt über eine Eingabe- und eine Ausgabeschicht, die jeweils eine bestimmte Anzahl von Neuronen enthalten. Tatsächlich befinden sich in einem NN zwischen der Eingabe- und der Ausgabeschicht zahlreiche sogenannte „versteckte Schichten“ (hidden layers), die ebenfalls aus Neuronen bestehen. Dies wird als Deep Learning bezeichnet, einer Unterart der neuronalen Netzwerke. Je nach Anwendungsfall (z. B. Bild- oder Textverarbeitung) ermöglichen solche Strukturen die Lösung komplexer Probleme mithilfe verschiedener Arten von NN. Für eine grobe Erklärung der Arbeitsweise genügt jedoch ein vereinfachtes Modell.

Ein praktisches Beispiel: Bewerberauswahl mit neuronalen Netzwerken und wie sie Entscheidungen treffen

Ohne zu sehr auf die Mathematik einzugehen, widmen wir uns direkt einem praktischen Beispiel. Ein Ziviltechniker (Statiker) sucht nach neuen Mitarbeitern und verwendet bei der Bewerberauswahl ein einfaches neuronales Netzwerk (NN). Die Kriterien für die Einladung zu einem Bewerbungsgespräch sind Studienrichtung, Berufserfahrung und der Notendurchschnitt im Studium. Das NN soll auf Basis dieser Kriterien vorhersagen, ob der jeweilige Bewerber zu einem Bewerbungsgespräch eingeladen werden soll (Ja) oder nicht (Nein).

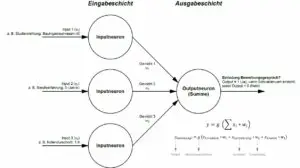

In Abbildung 1 sind drei Inputneuronen mit den genannten Kriterien dargestellt. Jedes dieser Kriterien wird als Zahlenwert berücksichtigt. Beispielsweise wird jeder relevanten Studienrichtung ein Index zugewiesen (z. B. Bauingenieurwesen = 4, Architektur = 3, kein Studium = 1 usw.). Diese Inputwerte werden durch die Daten des jeweiligen Bewerbers vorgegeben. Das Ausgabeneuron gibt auf Grundlage der Inputs und der zugeordneten „Gewichte“ entweder den Wert 1 (Ja) oder 0 (Nein) aus.

Der beispielhafte Bewerber aus Abbildung 1 hat Bauingenieurwesen studiert, bereits fünf Jahre in diesem Bereich gearbeitet und das Studium mit einem Notendurchschnitt von 1,9 abgeschlossen. Bei dieser Eingabe ergibt der Output des NN ein Ja (= 1), und der Bewerber wird eingeladen. Wie kann das NN diese Vorhersage treffen? Wie hat das neuronale Netzwerk gelernt?

Modelltraining und überwachtes Lernen: Wie neuronale Netzwerke lernen

Logischerweise muss dem neuronalen Netzwerk (NN) vorab anhand historischer Daten gezeigt werden, dass ein solcher Bewerber als potenzieller Mitarbeiter geeignet sein kann (Modelltraining der KI). Das NN hat während des Trainings gelernt, dass ein früherer Bewerber mit ähnlichen Inputwerten zu einem Bewerbungsgespräch eingeladen wurde. Gleiches gilt für Bewerber, die nicht eingeladen wurden, beispielsweise weil bestimmte Eingabewerte wie „kein Studium“ oder „mangelnde Erfahrung“ dazu geführt haben. Diese Lernmethode wird als überwachtes Lernen bezeichnet (siehe frühere Beiträge), da dem KI-Lernalgorithmus (hier dem NN) im Training für viele gegebene Beispiele (Eingaben,

z. B. Bewerber mit den jeweiligen Kriterien) die passende Lösung direkt vorgegeben wird (Ausgabe: Der Bewerber wurde eingeladen oder nicht).

Optimierung durch Fehlerkorrektur: Die Rolle der Aktivierungsfunktion

Wenn das KI-Modell im Training einem Bewerber absagt, der in der Realität jedoch eingeladen wurde, werden die Parameter im NN entsprechend angepasst. Diese Parameter sind die bereits erwähnten „Gewichte“ . Während des Trainings wird dieser Prozess so lange wiederholt, bis der Fehler zwischen der gewünschten und der tatsächlichen Ausgabe möglichst gering ist. Die Inputwerte werden mit den zugehörigen Gewichten multipliziert und die daraus gebildete Summe soll im Ausgabeneuron einen Wert zwischen 0 und 1 ergeben (angelehnt an eine Wahrscheinlichkeit). Um dies zu erreichen, wird die gewichtete Summe in eine Aktivierungsfunktion eingesetzt. Die Aktivierungsfunktion hilft dem neuronalen Netzwerk zu entscheiden, ob ein Neuron „aktiv“ wird („feuert“) oder nicht.

Anschließend muss definiert werden, ab welchem Schwellenwert ein Bewerber eingeladen wird. Das NN gibt als Output „Ja“ aus, wenn der Wert der Aktivierungsfunktion beispielsweise > 0,6 ist. Wenn also die Summe aus (z. B. 12) in die Aktivierungsfunktion eingesetzt wird und das Ergebnis 0,8 beträgt, wird der Bewerber eingeladen (Output = 1 oder „Ja“).

Zugegeben, das waren nun doch einige technische Hintergründe, die weniger auf die unternehmerische Seite eingehen. In der Praxis hängt der Erfolg neuronaler Netzwerke jedoch stark von den vorhandenen Daten und den Rahmenbedingungen im Unternehmen ab (z. B. möchte ich ein individuelles KI-Modell entwickeln oder ein fertiges Modell verwenden?). Kein KI-Modell wird effizient funktionieren, wenn historische Daten im Unternehmen unzureichend dokumentiert wurden. Der Einsatz neuronaler Netzwerke fasziniert zu Recht, sollte jedoch sorgfältig geplant werden. Sie sollten mitnehmen, wie NN grob funktionieren und dass die Auswahl und das Training neuronaler Netzwerke nicht zu unterschätzen ist. Nicht zu vergessen ist, dass die Forschung in diesem Bereich fast täglich Neuerungen hervorbringt.

Markus Nussbaum, Bauingenieur & KI-Beauftragter, in Kooperation mit tecTrain.at

(Veröffentlicht am 31.01.2025)

Qualitätsbetriebe.com

Qualitätsbetriebe.com Bauherrenhilfe.tv

Bauherrenhilfe.tv